Visión técnica

Shardy es una red descentralizada de infraestructura física que convierte dispositivos heterogéneos de navegador y equipos de consumo en una malla de cómputo masivamente paralela. La plataforma combina un plano de control de baja latencia implementado en Bun y SQLite con una malla libp2p para gossip, preprocesadores WASM compilados desde Rust y pipelines WebGPU definidos con TypeGPU para garantizar layouts de memoria tipados y alto rendimiento.

El plano de control implementa tolerancia a fallos bizantinos mediante consenso por redundancia, reasignación dinámica y una cola de mensajes muertos (DLQ). Las tareas se envían como un frame JSON de metadatos seguido de una carga binaria; los workers reconocen, preprocesan en WASM, ejecutan shaders WGSL en la GPU y generan una prueba criptográfica Groth16 vía SnarkJS. El orquestador verifica pruebas, aplica quórum y difundie los digests verificados por la malla P2P.

Elementos arquitectónicos clave:

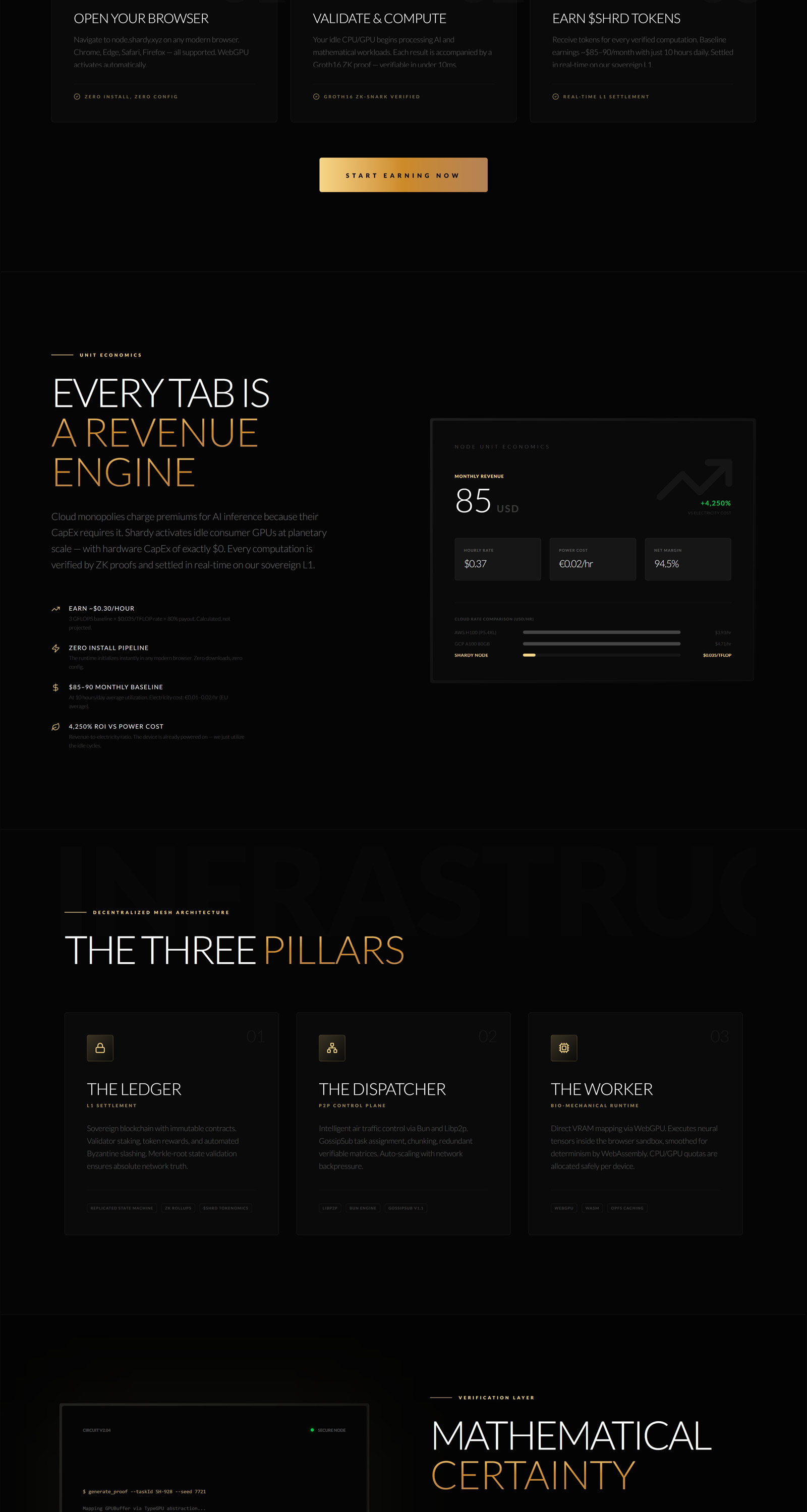

- Dispatcher (Bun): gestión del ciclo de vida, aplicación de REDUNDANCY_FACTOR, reintentos con backoff exponencial, DLQ y telemetría de progreso.

- Backbone P2P (libp2p): GossipSub para broadcast de estados verificados, Kademlia DHT + mDNS para discovery, handshake Noise y multiplexación Yamux/Mplex, con fallback a streams directos.

- Runtime WASM (Rust → WASM): slicing binario determinista, gestión de memoria alloc_bytes/dealloc_bytes, suavizado EMA para normalizar resultados numéricos entre GPUs y fallback en JS.

- Pipeline WebGPU: WGSL tipado con TypeGPU, asignación dinámica de GPUBuffer, transferencias zero-copy con SharedArrayBuffer y almacenamiento temporal OPFS para datasets grandes.

La seguridad y la corrección de Shardy se fundamentan en la integración ZK-SNARK. Los workers generan localmente pruebas Groth16 mediante un circuito Circom que liga taskId, seed, outputLen y resultDigest en un sistema de restricciones verificable. El orquestador mantiene un manifest de versiones de verificador para rotar claves sin downtime, y un guardado contra replay de pruebas en la base SQLite evita envíos duplicados.

Los retos de ingeniería incluyeron mantener determinismo entre distintos vendors de GPU, minimizar copias de memoria a nivel navegador y asegurar discovery en redes restrictivas. Las soluciones implementadas fueron: suavizado EMA para estabilidad numérica, rutas zero-copy con SharedArrayBuffer y OPFS para buffering intensivo, y discovery multi-protocolo combinando mDNS y Kademlia. El resultado es una malla de cómputo permissionless y rentable que proporciona garantías criptográficas y rendimiento competitivo frente a nubes centralizadas.